【東京農工大学】情報技術を用いて「ウェルビーイング」を実現する!

東京農工大学 藤波研究室

工学部 知能情報システム工学科

日常生活コンピューティング研究室(藤波研究室)

専門:ヒューマン・コンピュータ・インタラクション/

ヒューマン・インターフェース/ユビキタスコンピューティング/AI応用

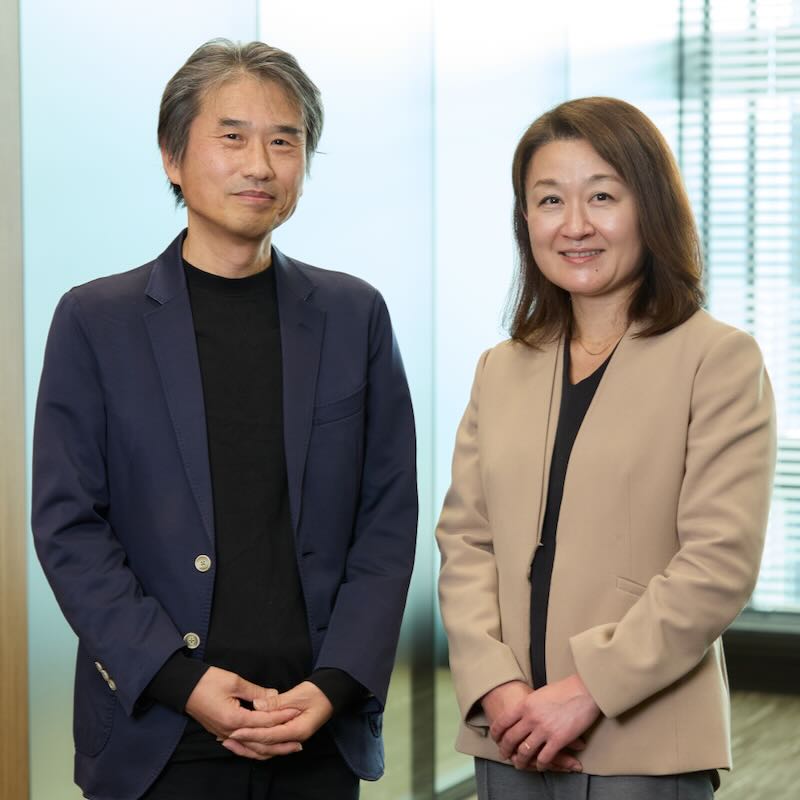

AI・データサイエンス系大学・学部の研究室では、どのような研究が行われている? データサイエンスを用いれば、人間の行動や感情を数値で可視化できるという。東京農工大学工学部知能情報システム工学科の藤波香織教授が取り組むのは、「視線」や「迷い」の「見える化」だ。これを「ウェルビーイング」の向上に役立てるのが目的だ。研究の詳細を見てみよう。

AIやIoTを用いて誰もが心地よく暮らせる世界をつくる

「ウェルビーイング」という言葉がある。身体的・精神的・社会的に健康な状態であることを指す。仕事や学校などの人間関係でストレスを抱えることが多い現代人にとって、心身ともに健康であることは、大きな価値なのだ。

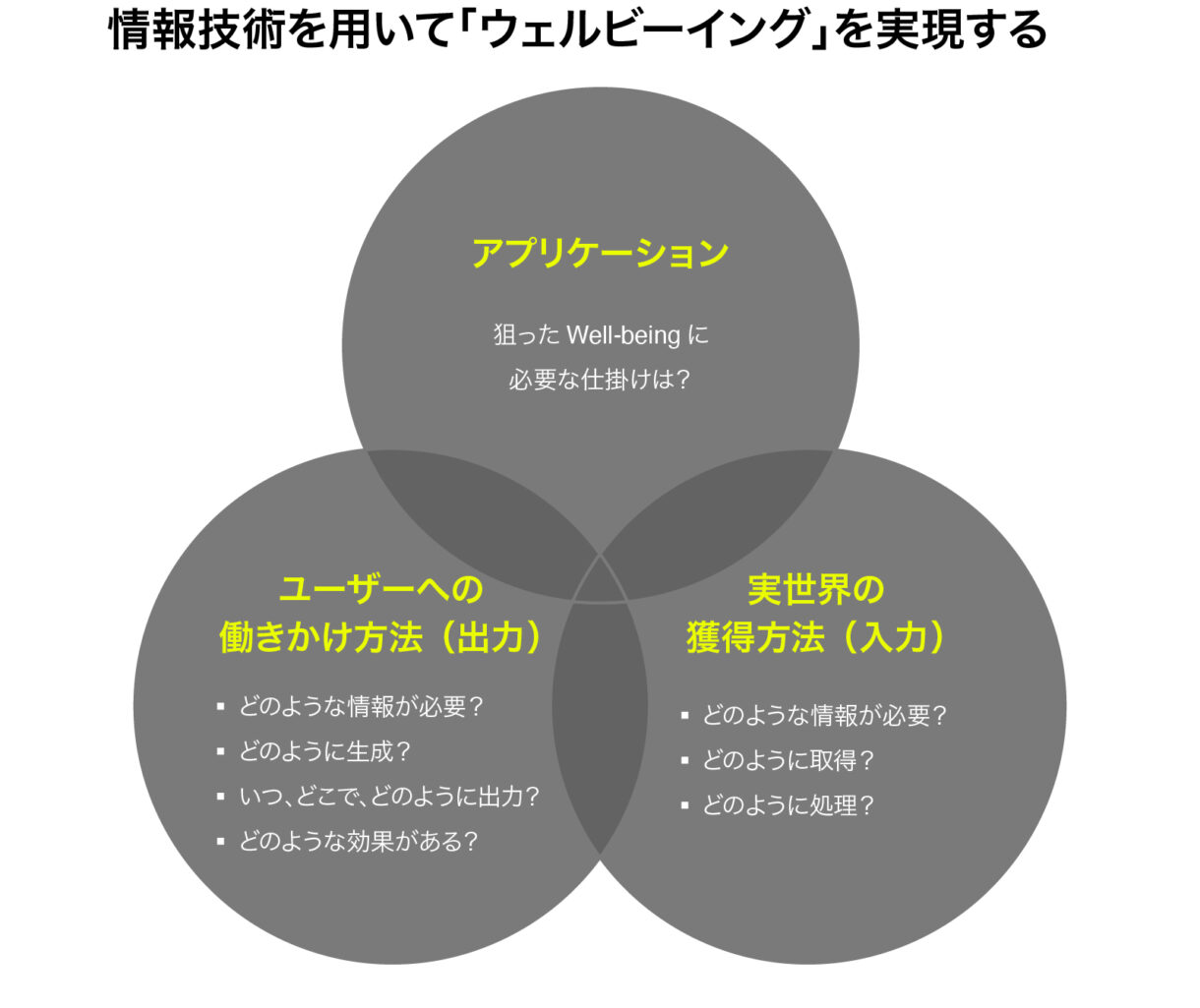

この「ウェルビーイング」を情報技術で支える研究に取り組む研究者がいる。東京農工大学工学部知能情報システム工学科の藤波香織教授だ。研究キーワードは、実世界のデジタル化(入力)とデジタル世界の実体化(出力)だという。

「AI(人工知能)やIoT(Internet of Things)などのテクノロジーを用いて、誰もが今までできなかったことが簡単にできる、誰もが仲よくなれる、心地よく健康で暮らせる、動物とも共存できる……そんな世界をつくりたいと考えています。研究分野としては、ヒューマン・インターフェース(HI)、ヒューマン・コンピュータ・インタラクション(HCI)、AI応用、AR(拡張現実)、VR(仮想現実)などにあたります。情報工学だけでなく、認知科学、心理学、動物行動学など、幅広い分野の知識を融合した研究になります」

ヒューマン・インターフェース(HI)とは、人間とコンピュータが情報のやりとりをする道具や手段のこと。パソコンのマウスやスマホのタッチパネルがHIにあたる。ユーザー・インターフェース(UI)と呼ばれるものも同義と考えていいだろう。さらに、ヒューマン・コンピュータ・インタラクションは、人間とコンピュータの相互作用のことを指す。最近のAIスピーカーとの会話などは、HCIの代表例といえる。

藤波教授は、人間とコンピュータが心地よくコミュニケーションをするためには、どのような環境が適切なのかを最新のセンサやAIの機械学習を用いて、調べている。

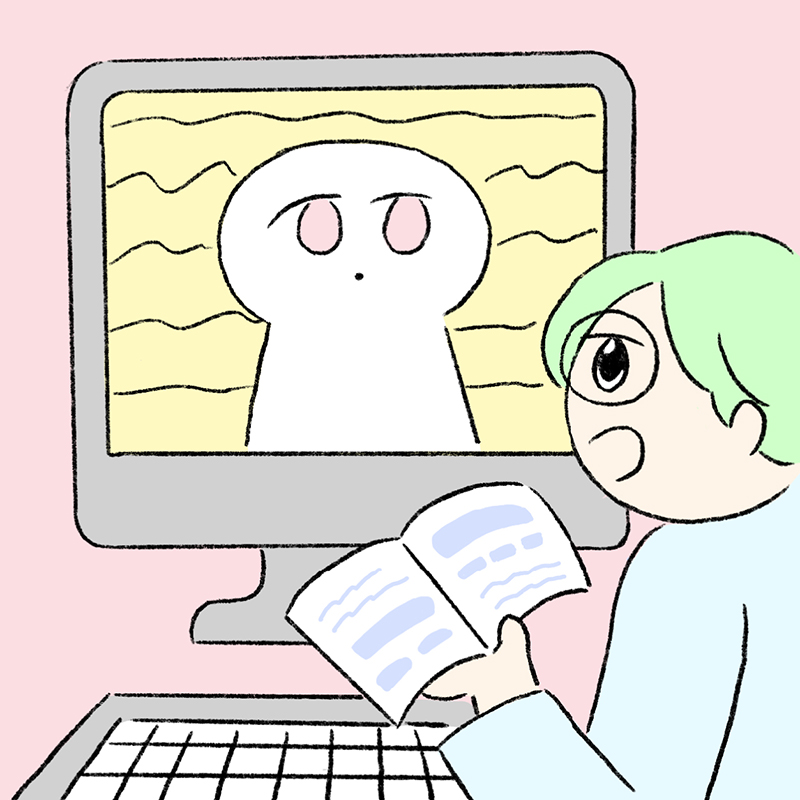

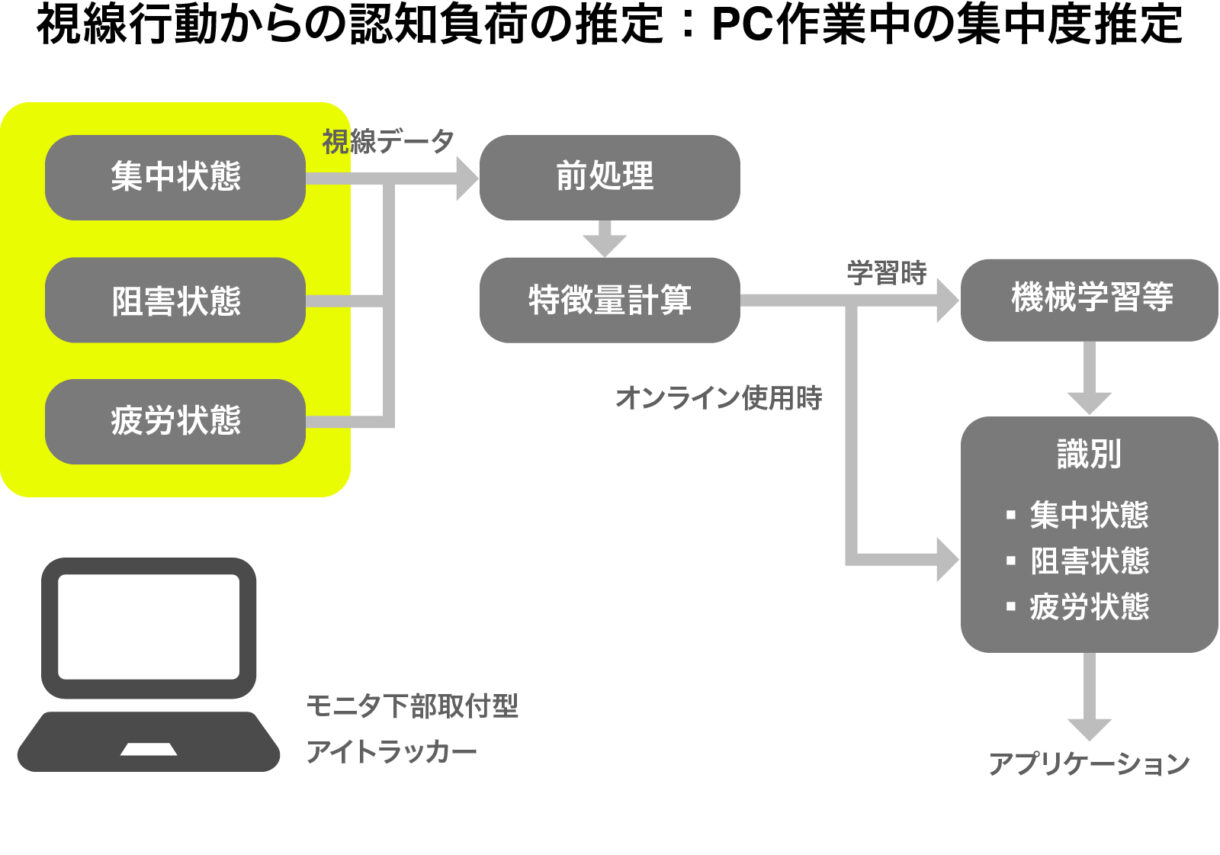

視線行動のデータから認知負荷を推定する

「研究の一例として、『視線行動からの認知負荷の推定』があります。これは、パソコン作業中の集中度を測定する研究です。実験では、アイトラッカーという人の視線をリアルタイムで追跡するセンサを用いて、パソコン画面の中でユーザーがどこを見ているかを記録します。視線の動き方の特徴を数値化して、コンピュータ側がユーザーの状態を把握できるようにするのが目的です。この技術を使えば、ユーザーの視線から集中力が切れてきたことがわかったら、コンピュータが『そろそろ休憩したほうがいいですよ』と話しかけるようなことが可能になります」

実験では、テキストを黙読している被験者に、さまざまな阻害タスクを与えて、「集中状態」「阻害状態」「疲労状態」における視線の動きをトラッキングする。「集中状態」を検出する実験では、被験者は何にも邪魔されることなく集中してテキストを黙読する。その後、「阻害状態」の検出では、被験者が黙読している最中にイヤホンから数字の音声を流し、1つ前や2つ前の数字を復唱するように指示する。これでは集中が阻害されても無理はない。そして、「疲労状態」はこの実験を休憩なしで続けた状態で、テキストを黙読してもらう。視線行動からは、明らかに集中状態とは違うデータが検出されるという。

「視線行動のデータを取得したら、これと被験者の状態(集中・非集中など)をペアにして、コンピュータに学習させます。いわゆるAIの機械学習ですね。大量の実験データを読み込ませて特徴を検出することで、AIはユーザーが今どのような状態なのか正確に評価できるようになります。そうすれば、AIがユーザーの『集中状態』『阻害状態』『疲労状態』を自動判別するアプリケーションの開発などにつなげることができます」

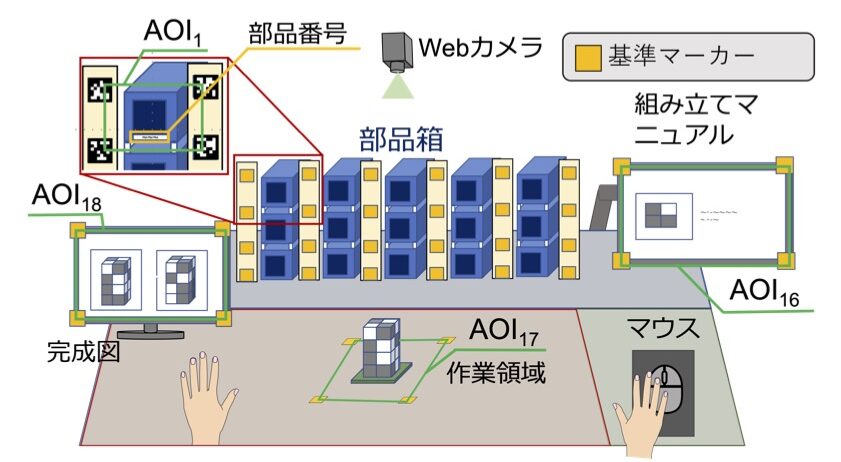

視線行動から組み立て作業時の「迷い」を推定する

他にも「視線行動を用いた組み立て時の迷いの検出と種類の推定」という研究がある。これは工場などにおいて、組み立て作業に従事する作業者の熟練度の推定や支援タイミングの見極め、マニュアルの改定などを目的としたもので、作業者が「迷っている」状態をコンピュータで検出するという。

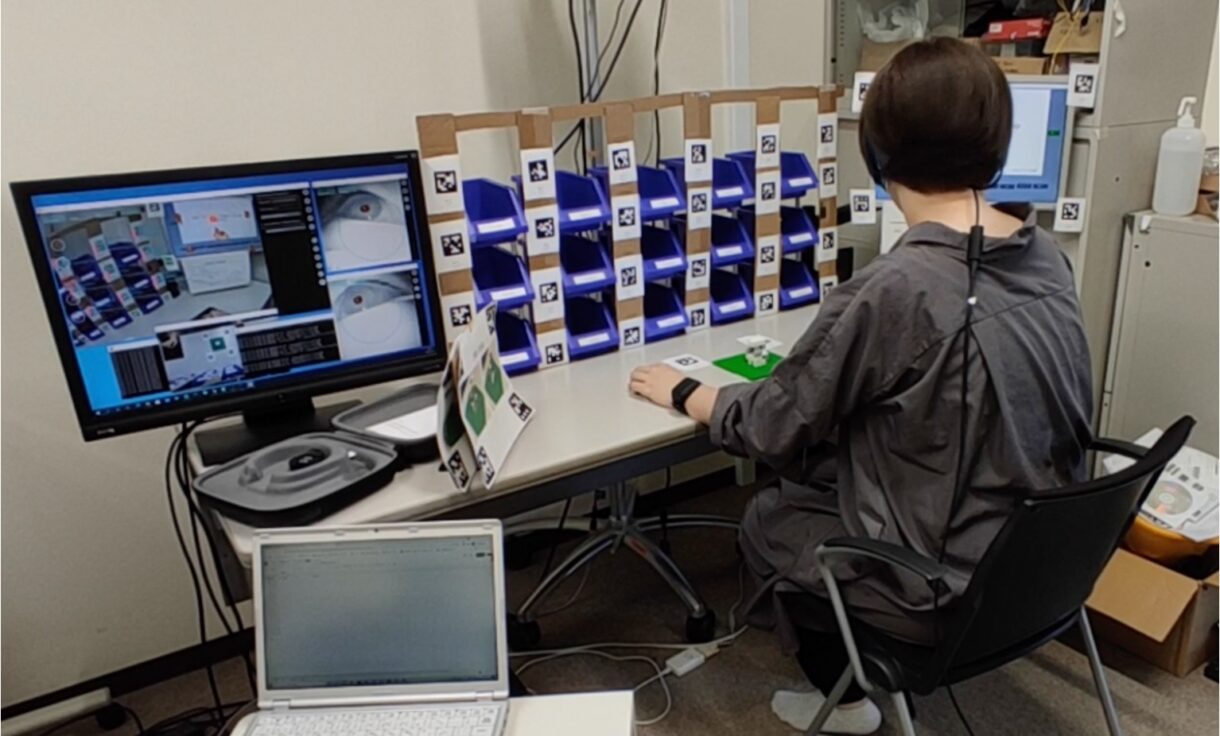

実験で用いる装着型のアイトラッカー

「こちらの実験では、装着式のアイトラッカーを用いて、視線のデータを取得します。目的は、組み立て作業における迷いの有無を検出すること。作業者は、どこで、どの部品を使って、どうすればいいのか……とさまざまな要因で迷いを経験します。特定の視線行動のパターンと迷い状態の関係をAIに学習させ、迷いの種類を推定させるのがゴールとなります」

AOI(Area of Interest)間の遷移のパターン化

AOI (Area of Interest):関心領域1から18までの番号が付けられた矩形領域に視線が入ったときにそこを見たと判定。例えば、AOI 16は組立マニュアルに割り当てられているので、AOI 16に視線が入ると「説明図を見た」と判断。

実験では、工場の作業場を再現する大がかりなセットを作成。デスクの上にパソコンのモニタ、さまざまなパーツが置かれた棚、組み立てのマニュアルなどを並べ、これらをAOI(Area of Interest)として設定。アイトラッカーで視線の遷移を追跡する。この実験と被験者インタビューから「迷いなし」「部品探索の迷い」「接合(組み立て時)の迷い」という迷いの種類やレベルを特定することができ、これを作業マニュアル改定につなげる道筋なども見えてきたという。

棚に貼り付けたコードからAIが視線のAOI(Area of Interest)を認識する

「手の動き、視線行動、脈拍などの生体情報などを統合すれば、さらに正確な『迷い』の推定が可能になるでしょう。この技術が確立できれば、Webサイトのユーザビリティ評価、e-ラーニングの評価などに応用できると考えています」

農学部と「アニマルウェルフェア」の共同研究も

最後にもうひとつ、藤波研究室が取り組むユニークな研究を紹介しよう。それは、「アニマルウェルフェア研究の支援ツール」。工学部と農学部で構成される東京農工大学では、工学と農学を融合した共同研究も盛んに行われている。これもそのひとつで、ニワトリにセンサを付けて、行動を評価・分類する研究だという。

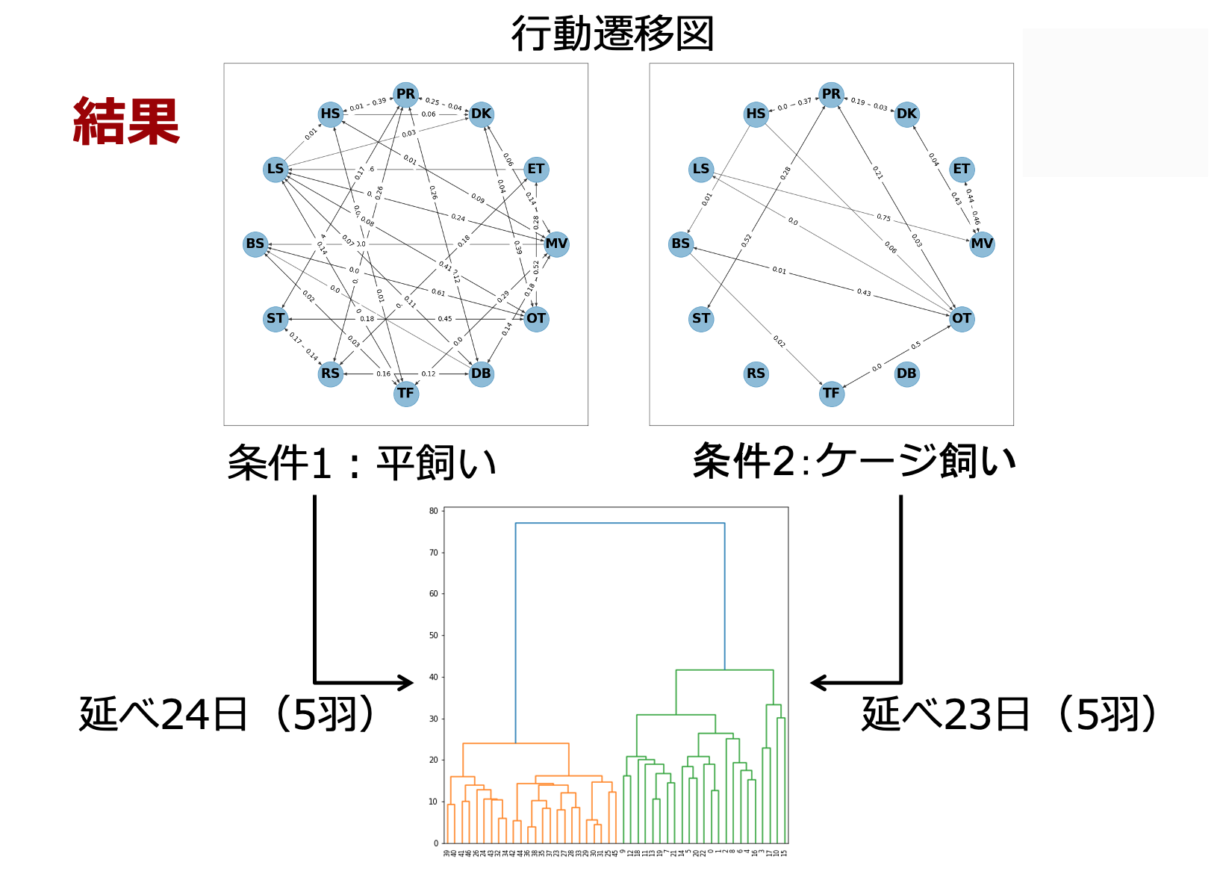

「農学の分野では近年、アニマルウェルフェア(動物福祉)の研究が注目されています。例えば、家畜の飼育環境などを調査し、動物にストレスを与えていないかを検証するものなどがこれにあたります。私たちは、農学部の研究室と共同で、ニワトリに加速度センサを装着し、AIの機械学習を用いて、12種類の行動を分類し、ケージの中のニワトリがどのような状態なのかを調べました」

加速度センサで取得したニワトリの行動遷移図

行動遷移図を数値化して似たもの同士をクラスタリングでグループ化

録画データから目視でニワトリの健康状態を観察する従来の方法と比較し、飛躍的に詳細なデータを取得することができ、さまざまな応用が期待できるという。ヒューマン・コンピュータ・インタラクションの技術は、動物にも応用できると考えると実に興味深い。

「最先端のセンサとAIの機械学習などを用いることで、『視線』や『迷い』だけでなく、『動物の健康状態』まで、実にさまざまなものをデータによって、『見える化』することができます。こうしたデータサイエンスの知見を幅広い分野で社会実装していきたいと考えています」

研究室の詳細

日常生活コンピューティング研究室(藤波研究室)

実世界のデジタル化(入力)とデジタル世界の実体化(出力)に関する研究に取り組む。人間の日常行動認識や動物の行動パターン解析、携帯機器の所持位置検出、投影型拡張現実感(AR)における見やすい/記憶に残る情報提示、人を惹きつける情報提示など研究テーマは多岐にわたる。

詳細はこちら

日常生活コンピューティング研究室(藤波研究室)

Text by 丸茂健一(minimal)/Illustration by 竹田匡志